Oppenheimer : Christopher Nolan fait un parallèle terrifiant entre l'IA et son film

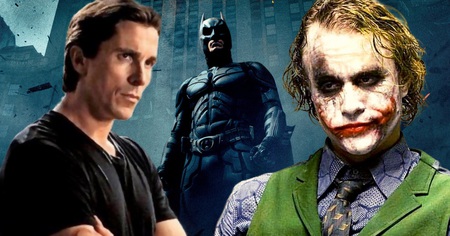

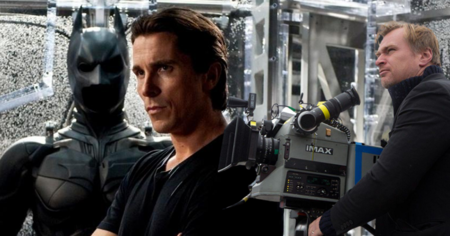

C'est l'un des films les plus attendus de l'année : ce mercredi 19 juillet, Oppenheimer, la nouvelle oeuvre de Christopher Nolan, sera enfin projetée dans les salles obscures. Actuellement en pleine promotion de son biopic sur le fameux chercheur qui a dirigé, aux États-Unis, la mise au point de la bombe atomique pendant la Seconde Guerre Mondiale, le réalisateur a alerté sur les dangers d'une autre invention. La comparaison du cinéaste entre le développement rapide de l'intelligence artificielle et la création de la bombe atomique va vous faire froid dans le dos...

l'invention de l'IA comparée à celle de la bombe atomique

Parmi les détracteurs de l'intelligence artificielle, on peut compter Christopher Nolan. À la suite d'une projection en avant-première de son nouveau film, Oppenheimer, à New York, le réalisateur a exprimé de sérieuses craintes quant à l'évolution rapide (voire incontrôlée) de cette technologie dans nos vies. Au cour de sa prise de parole, il n'a pas hésité à faire un effrayant parallèle entre la manière dont le chercheur au coeur de son long-métrage a été chargé par les autorités militaires américaines de mettre au point la bombe atomique pendant la Seconde Guerre Mondiale, et l'irresponsabilité générale concernant l'IA.

Au cours des 15 dernières années, de nombreuses entreprises ont utilisé des mots tels qu'algorithme, sans savoir ce que ça signifie d'un point de vue mathématique ; ces personnes ne savent pas ce qu'est un algorithme. Les gens de mon secteur qui en parlent ne veulent tout simplement pas assumer la responsabilité de ce que fait l'algorithme.

Appliquée à l'IA, cette possibilité est terrifiante. Terrifiante. Notamment parce que les systèmes d'IA finiront par être utilisés dans les infrastructures défensives. Ils seront en charge des armes nucléaires. Si l'on considère qu'il s'agit d'une entité distincte de la personne qui manie, programme et utilise l'IA, nous sommes condamnés. Il s'agit d'une question de responsabilité. Nous devons tenir les gens responsables de ce qu'ils font avec les outils dont ils disposent.

Un commentaire on ne peut plus d'actualité, alors qu'Hollywood est quasiment à l'arrêt suite à la grève des acteurs américains, qui ont rejoint cette semaine les scénaristes dans leur mouvement d'envergure contre les studios. L'un des principaux problèmes soulevés par leurs syndicats est la question de l'IA et de son impact existentiel potentiel dans l'audiovisuel.

Et vous, que pensez-vous des propos du réalisateur ?

Au premier regard de travers, ça se menace comme des ivrognes en sortie de boîte et ça remet en question toute la survie de l'humanité.

Et vous voulez me faire croire que le plus terrifiant, ce serait de laisser les armes à une machine, plutôt qu'à ces hommes ? Eh beh

une machine peut avoir une panne, un bug qui le fera dévié. Des sondes spatiales se sont crashées car les différentes équipes se sont pas mises d'accord sur les unités utilisées pour les distances, pour petit exemple.

Même si demain Poutine décide de lancer des armes nucléaires, il va devoir transmettre cet ordre via un paquet d'humains qui vont tous avoir la possibilité de ne pas obéir. Une IA, une fois qu'elle aura pris la décision, les missiles partiront dans la seconde. C'est tout le propos de l'excellent Wargames.

Tu peux regarder la vidéo d'Astronogeek sur les fois où on est passé proche d'une guerre nucléaire, dans plusieurs cas, un instrument électronique a cru voir quelque chose mais un humain s'est dit que ça devait être faux.

Et si tu te laisses embarquer dans la chaîne Astronogeek, tu verras le pendant soviétique de ça, un ordi qui contrôlerait leurs forces nucléaires, et je crains plus ça que tous les dirigeants humains de la planète.

Les soviétique avaient cru à une attaque de missile nucléaire et ça c'est joué sur une décision humaine malgré leur procédure (qui étaient d'envoyer à leur tour tous leurs missiles)

Il a fallu que l'ingénieur soviétique se rende compte que c'était le rayonnement du soleil sur les satellites qui enduisaient les instruments de mesure en erreur.

Stanislav Petrov pour ceux qui veulent connaitre l'histoire du gars.

On a eu Tchernobyl, où les opérateurs ont décidé sciemment d'ignorer les avertissements des systèmes.

Plus récemment, les modèles de surveillance des maladies et les IA comme BlueDot qui avaient alerté sur le danger imminent d'un virus comme le Covid et qui n'ont pas été pris au sérieux.

Et je pourrais faire une liste longue comme le bras sur les crash aériens où les pilotes ont snobé les indications de la machine.

D'ailleurs, en parlant d'Astronogeek, parlons aussi de la navette Challenger, où là aussi l'ordinateur avait tout annoncé et que les équipes n'ont pas écouté.

Je ne dis pas que l'IA est parfaite. Mais je ne la trouve pas moins responsable qu'un humain, loin de là.