Écraser des personnes âgées ou des jeunes, le dilemme moral de la voiture autonome

Vaut-il mieux écraser des sans-abri ou des animaux ? Des gens corpulents ou fins et sportifs ? Des jeunes ou diriger la voiture dans un mur ? Des questions problématiques qui sont le sujet d'une étude lancée en 2016 par le MIT, et dont les résultats font aujourd'hui l'objet d'une publication dans la célèbre revue Nature. Sachez que vous pouvez également faire le test par vous-même, et savoir si vous vous rapprochez de la moyenne, ou non.

Des choix moraux sur lesquels il faudra statuer

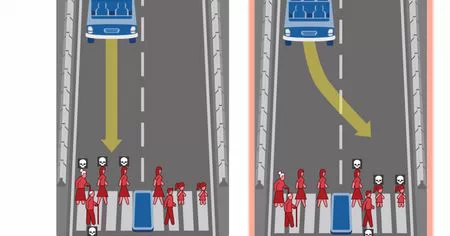

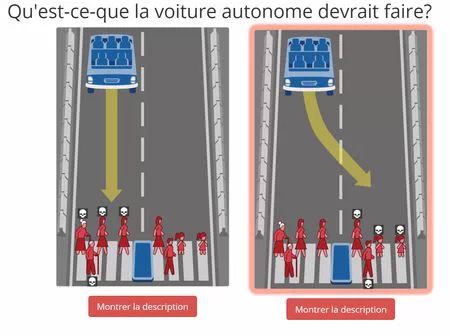

Le scénario est simple : une voiture autonome ne peut pas freiner et devant elle, un choix impossible se présente, que faut-il faire ? Ce choix impossible est ici représenté sous la forme de piétons, humains ou animaux. La voiture doit-elle les écraser, de manière à préserver la sécurité de ses passagers ? Ou au contraire dévier la voiture en direction d'un mur et éviter les piétons ? Ce choix moral est concerné par divers facteurs comme le nombre de passagers et de piétons, leur état de santé physique, leur âge ou encore leur statut social. Vaut-il mieux écraser deux personnes qui ont traversé au rouge ou une seule qui a traversé au vert ? Un dilemme auquel la voiture devra bien évidemment répondre.

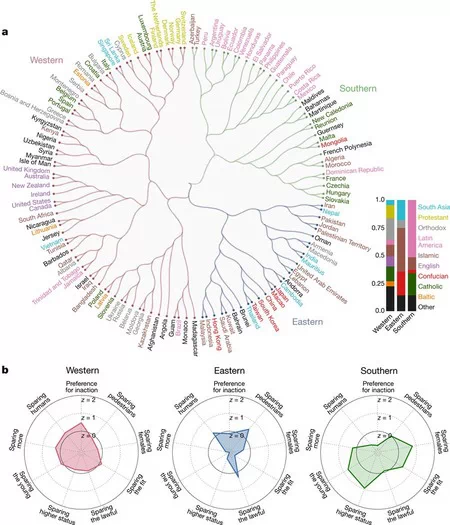

L'engouement autour de ce projet a été phénoménal, notamment grâce au côté ludique de ses questions, qui traitent tout de même de la mort d'êtres humains. Plus de 40 millions de réponses ont été enregistrées et plusieurs millions d'internautes à travers le monde ont souhaité s'essayer à ce dilemme moral. Les différentes réponses ont ensuite été divisées selon le pays des utilisateurs en question. Dans les régions du sud, dans lesquelles on peut retrouver la France, les utilisateurs ont davantage tendance à épargner les piétons en fonction de leur statut social élevé.

A contrario, pour les pays de l'Ouest, parmi lesquels on distingue le Japon ou encore la Chine, les utilisateurs ont une préférence pour l'inactivité, et foncer tout droit, sans prendre en compte les personnes ou les objets se trouvant devant la voiture. En plus de lever le voile sur les préférences morales des utilisateurs à travers le monde, cette étude pourrait également mener à la création de lois diverses concernant les voitures autonomes. Lois qui différeraient selon les pays et qui pourraient éventuellement, par la suite, amener les utilisateurs à changer les préférences par défaut du véhicule en fonction du pays dans lequel il se trouve, à la manière de la sélection d'une langue dans un menu.

je me réjouis de voir les premières articles de journal.

Pour peu que ça soit une mercredes et Jackpot, c'est un ingénieur nazi qui a codé le programme de l'auto

L'intérêt du train qui écrase sur une voix un groupe de personne ou une seule personne c'est que y'a que 2 choix possible réellement.

Là finalement la voiture autonome a le choix de taper le mur pour tenter de s'arrêter.

Après le choix moral c'est tuer les personnes agées pour sauver les enfants. N'oublions pas l'expression "les femmes et les enfants d'abord".

Le choix logique lui se serait de ne pas interférer dans ce choix. Car faire le choix tuer est un meurtre, ne pas faire le choix de tuer c'est un accident mortel.

J'demande vraiment ça comme ça hein

Peu importe leur statut social, le groupe 2 n'a pas à subir les incivilités du groupe 1... Jvois même pas pourquoi y a débat

Mais je te rejoins là dessus, si les personnes traversent au vert alors la voiture l'aura anticipé et il n'y aura pas collision. S'il y a collision ça veut dire que les piétons n'ont pas respecté les règles et dans ce cas là, à eux d'assumer leurs actes et non pas les piétons d'à côté ni le conducteur.

Ce qui est plus compliqué en revanche ce sont les enfants, un avocat pourra toujours dire qu'un enfant n'est pas responsable de ses actes et que dans ce cas là, la voiture aurait dû l'éviter.

C'est justement à cause de ce genre de choses qu'ils ont lancé ces tests, j'y avais participé il y a un an ou deux.

J'ai pas tout compris

pardon je m'égare.